Vos équipes utilisent déjà l’IA, avant que vous l’ayez décidé.

Je constate que les pratiques ont précédé les cadres.

Si les outils sont nouveaux, les questions de pilotage, elles, restent très classiques : qui produit quoi, avec quelles données, selon quelle méthode, avec quel niveau de validation ?

C’est ce que je vous propose d’explorer aujourd’hui avec moi, à partir de situations réelles.

Les usages IA ont déjà commencé dans les équipes

L’IA s’installe d’abord dans les petites tâches du quotidien : reformuler un e-mail, résumer une réunion, préparer une trame, chercher un angle.

Les collaborateurs ne communiquent pas forcément dessus parce que cela leur semble banal. Ou qu’ils ne savent pas si c’est autorisé ou qu’ils craignent que ça dévalorise leur travail.

Ce non-dit masque des usages largement répandus. Et dans les entreprises que je rencontre, ils ont déjà modifié une partie des routines de travail.

Pourquoi ces usages restent souvent hors radar

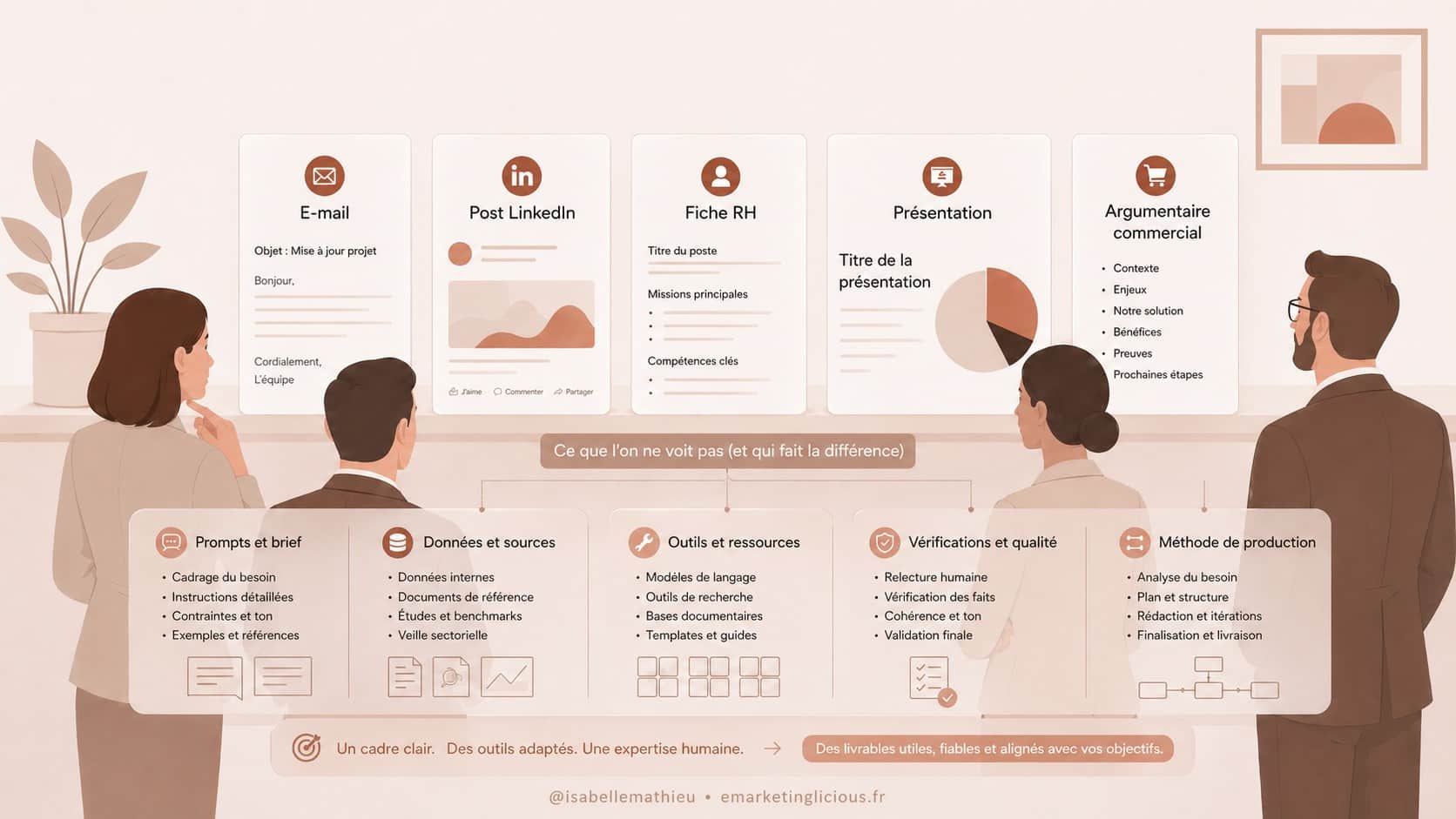

Lorsqu’un collaborateur produit un document, vous voyez le résultat final, mais vous ne savez pas comment il a été produit. Ou encore quel outil a été utilisé, quelles données ont été intégrées dans le prompt, comment le collaborateur a travaillé, ce qu’il a vérifié ou non.

Du côté des outils, vos collaborateurs n’utilisent pas toujours ceux dont ils disposent officiellement. Certains ont accès à Copilot dans Teams sans le savoir, pendant que d’autres utilisent ChatGPT en accès libre en parallèle. Votre écosystème réel ne correspond donc pas toujours à celui que vous avez déployé.

Les données intégrées dans les prompts restent peu visibles. Un échange avec un chatbot contient parfois des informations clients, des éléments contractuels, des données de stratégie interne ou des données personnelles. Selon l’outil utilisé et son paramétrage, ces informations sont susceptibles de sortir de votre environnement maîtrisé, avec peu de visibilité interne.

D’un collaborateur à l’autre, les méthodes varient. Certains vérifient systématiquement, reformulent, recoupent. D’autres intègrent les contenus générés sans relecture approfondie. Un compte rendu, une analyse ou un argumentaire a parfois été construit en grande partie avec un outil que personne n’a validé.

Les usages utiles restent parfois isolés. Un collaborateur crée un prompt efficace pour effectuer une tâche, sans qu’il le partage en interne. À l’inverse, un prompt approximatif ou une utilisation risquée circule parfois de main en main.

Dernier point : le périmètre hors radar dépasse parfois les équipes internes. Ainsi, dans une situation observée récemment, une agence intégrait l’IA dans sa production sans en avoir informé son client. Les livrables étaient remis, alors que le processus de production restait invisible pour l’organisation qui les commandait et les validait.

Pour faire le point sur votre situation, posez-vous trois questions simples : savez-vous quels outils vos équipes utilisent réellement, avec quelles données et selon quelle méthode ?

Ce que ces usages changent selon les métiers

Les usages IA hors radar ne produisent pas des effets identiques selon les métiers. Un même outil peut fragiliser un positionnement marketing, lisser une prise de parole LinkedIn, standardiser une fiche de poste, affaiblir une prospection commerciale ou compliquer le travail de validation d’un manager.

C’est pour cette raison qu’une approche uniforme atteint vite ses limites : chaque fonction a ses usages, ses données sensibles, ses livrables et ses points de vigilance.

IA et marketing : le risque de la généricité stratégique

Les équipes marketing utilisent l’IA pour générer des idées de campagnes, rédiger des briefs, produire des angles éditoriaux ou analyser des positionnements concurrentiels.

Le risque le plus courant tient à la production d’hypothèses faibles, formulées avec assurance. Un angle paraît pertinent. Un brief semble structuré. Une recommandation donne une impression de méthode. Pourtant, l’analyse peut rester trop générique, trop peu reliée au marché, aux clients, à la concurrence ou au positionnement réel de l’entreprise.

L’IA accélère la production d’une base de travail. Elle peut aussi donner trop vite une forme aboutie à une réflexion encore insuffisamment qualifiée.

La connaissance du marché, la compréhension des clients, les arbitrages de marque et la lecture concurrentielle restent des responsabilités marketing. C’est à ce niveau que l’usage de l’IA doit être encadré : qualité rédactionnelle, pertinence des hypothèses, lecture du marché et cohérence avec le positionnement.

IA et communication : le risque du désalignement contextuel

En communication, l’IA sert souvent à reformuler des messages sensibles, produire des éléments de langage pour les dirigeants ou préparer des contenus corporate.

Un texte fluide et bien structuré peut sembler abouti sans être adapté au contexte, au niveau de sensibilité du sujet ou aux arbitrages en cours au sein de l’organisation.

La communication corporate repose aussi sur le timing, la responsabilité portée et la connaissance des équilibres internes. Une formulation correcte ne suffit pas lorsque le message engage la parole de l’entreprise, d’un dirigeant ou d’une fonction sensible.

IA et réseaux sociaux : le risque du lissage éditorial

L’outil améliore la régularité éditoriale. Sur la qualité des prises de parole, l’effet est moins prévisible.

Je pense notamment à LinkedIn, où la valeur d’un contenu repose sur la précision, l’expérience, le point de vue et la capacité à relier un sujet à une réalité métier. Quand l’IA sert seulement à produire une formulation correcte, elle réduit ce qui rendait la prise de parole utile : le contexte, l’exemple vécu, le vocabulaire métier, l’arbitrage personnel.

Pour les programmes d’employee advocacy et les dirigeants, c’est un sujet de vigilance directe. Sans méthode partagée, les écarts de ton, de posture et de qualité entre collaborateurs nuisent à l’image de l’organisation.

Dans un réseau de franchisés du secteur automobile observé récemment, des collaborateurs généraient des visuels avec l’IA et alimentaient directement leurs comptes sur les réseaux sociaux. Certains contenus pouvaient s’éloigner des modèles réellement disponibles ou des visuels validés par la marque. La structure centrale ne savait pas toujours quels outils étaient utilisés, ni sur quelle base visuelle les contenus étaient produits. Le risque portait sur la cohérence éditoriale, la conformité des messages, la confiance client et la maîtrise de l’image de marque.

IA et RH : le risque de standardisation sur des sujets humains

Fiches de poste, trames d’entretien, supports d’intégration, contenus de formation interne : les équipes RH utilisent l’IA pour accélérer la production de ces documents.

Ces usages font gagner du temps. Un texte RH porte une représentation du poste, de la culture interne et de la promesse employeur : c’est là que l’attention doit se concentrer.

Le risque tient à l’effacement de ce qui rend l’entreprise identifiable comme employeur. Une fiche de poste générée trop vite peut ressembler à celle d’un concurrent : mêmes formulations, mêmes promesses générales, mêmes critères vagues.

L’IA devient utile lorsqu’elle aide à préciser la réalité du poste : responsabilités, conditions d’exercice, niveau d’autonomie, attentes managériales.

IA et commercial : le risque de l’illusion d’échelle

La personnalisation des e-mails de prospection, la préparation d’argumentaires et la recherche préalable aux rendez-vous sont des usages fréquents.

Le risque principal tient à l’illusion d’échelle. L’IA permet de produire plus vite des messages personnalisés en apparence, mais pauvres en lecture client. Le message semble adapté, tout en restant générique dans son raisonnement.

À petite dose, cette faiblesse passe parfois inaperçue. À grande échelle, elle peut dégrader la qualité des approches, la crédibilité des équipes commerciales et la confiance des prospects. Dans les dispositifs d’e-mailing intensifs, elle peut aussi peser sur la délivrabilité et la réputation des domaines d’envoi.

La vérification des informations client reste donc un point critique. Une donnée incorrecte, même bien formulée, peut compromettre une relation commerciale.

IA et management : le risque d’un pilotage incomplet

Les managers sont aussi concernés. Comptes rendus, synthèses de réunions, préparation de décisions : l’IA intervient déjà dans des tâches qui touchent directement au pilotage.

Le manager doit donc disposer de repères pour évaluer un livrable assisté, demander une vérification, repérer une réponse insuffisante et fixer des limites opérationnelles.

Il se trouve souvent en première ligne, car il est évalué sur la qualité des résultats, rarement sur la façon dont ces résultats ont été produits.

Les questions à poser deviennent alors très concrètes : quelle donnée a été utilisée ? Quelle consigne a été donnée à l’outil ? Quelle vérification a été faite ? Quelle part du document relève encore d’une analyse humaine ?

Ce que les pratiques dispersées peuvent fragiliser

Quand les usages IA restent dispersés, trois réalités deviennent plus difficiles à tenir.

Ce qui devient moins visible. L’entreprise ne voit pas toujours les outils utilisés, les données intégrées, les consignes données à l’IA, les étapes de vérification et la part de reprise humaine. Cette perte de visibilité expose l’organisation sur les données internes, les informations clients et les contenus sensibles. Elle complique aussi la traçabilité : quand une production pose problème, il devient difficile de comprendre ce qui vient de l’outil, ce qui a été vérifié et ce qui a simplement été repris.

La question des droits d’exploitation en est une illustration directe. Sur certains outils de génération d’images, les conditions d’usage commercial dépendent du type de compte, du statut de l’utilisateur, de l’origine des visuels et des droits associés aux images utilisées ou retravaillées. Ces points figurent dans les CGU. Ils sont rarement vérifiés par les équipes qui produisent les contenus, ni par les directions qui les valident.

Ce qui devient plus uniforme. L’IA produit souvent des contenus fluides, structurés, immédiatement utilisables en apparence. Dans le marketing, la communication, les réseaux sociaux ou les RH, des contenus corrects peuvent progressivement affaiblir la singularité éditoriale. Les formulations se ressemblent, les prises de parole perdent en précision, les contenus gagnent en volume et perdent en distinctivité. Pour une marque, ce lissage réduit la qualité perçue du discours. Pour un programme ambassadeur, il diminue la crédibilité des collaborateurs.

Ce qui devient plus difficile à évaluer. Une réponse bien formulée peut masquer une faiblesse de raisonnement. Le style donne une impression de solidité, la structure donne une impression de méthode. Pourtant, une synthèse peut omettre un point essentiel, une recommandation peut reposer sur une hypothèse fragile, une analyse peut manquer de contexte.

Les managers doivent alors évaluer le résultat final, le niveau de vérification effectué et la qualité du raisonnement sous-jacent. Cette difficulté crée des écarts de maturité entre collaborateurs : certains progressent rapidement, d’autres produisent plus vite avec une qualité inégale, d’autres restent en retrait.

Comment reprendre la main sur les usages IA

Reprendre la main commence par l’existant. Voici la démarche que je vous propose.

1. Observer les usages réels

Cette observation demande un cadre clair. Les collaborateurs parlent plus facilement de leurs usages lorsque la démarche n’est pas présentée comme un contrôle individuel.

Le diagnostic doit partir des situations de travail, des livrables et des irritants, avec une consigne simple : comprendre les pratiques pour les améliorer, et non pas pour évaluer les personnes. Selon le contexte, les retours peuvent être recueillis de manière anonymisée ou travaillés à partir d’exemples de documents et de cas d’usage.

Avant toute formation ou tout cadrage, l’entreprise identifie les outils utilisés, les tâches concernées, les données mobilisées et les livrables produits.

2. Distinguer les usages utiles des usages à risque

Les usages présentent des niveaux de valeur et de risque très différents.

Certains apportent une valeur réelle et peuvent être capitalisés. D’autres méritent d’être encadrés ou corrigés.

Qualifier les usages selon trois critères permet de prioriser : la valeur apportée, le niveau de risque et le degré de maîtrise par les équipes.

3. Donner des repères communs

Les équipes ont besoin de principes clairs : quelles données ne doivent pas être intégrées dans un prompt, comment vérifier un contenu généré, comment distinguer une aide à la formulation d’une analyse à part entière, qui valide un document sensible.

Ces repères doivent rester pratiques : exemples concrets, cas limites, critères de vérification, responsabilités de validation.

4. Former selon les métiers

Une formation générique sur l’IA atteint rapidement ses limites.

Former une équipe marketing suppose de travailler sur des briefs, des contenus, des campagnes et des analyses. Former une équipe RH demande d’aborder les fiches de poste, les supports internes et la marque employeur. Former des managers exige de traiter la supervision, la relecture et la qualité des productions.

La montée en compétence devient utile lorsqu’elle part des livrables réellement traités par chaque fonction, avec ses contraintes et ses cas d’usage spécifiques.

5. Outiller les managers

Les managers jouent un rôle central dans la maturité IA de l’organisation.

Leur rôle consiste à repérer les situations à risque, évaluer la qualité d’une production, demander une vérification, encourager les bons usages et poser des limites opérationnelles.

Cette supervision s’inscrit dans un rôle qu’ils exercent déjà : valider des productions, arbitrer, demander des corrections, fixer un niveau d’exigence.

Elle s’exerce sans expertise technique particulière. Elle suppose de savoir poser les bonnes questions sur les données utilisées, les consignes données, les vérifications effectuées et la part d’analyse humaine restante.

6. Suivre les usages dans le temps

Les outils et les méthodes changent à un rythme soutenu.

Mettre en place des retours d’expérience réguliers, capitaliser sur les bonnes pratiques et actualiser les repères communs permet d’ajuster le cadre à mesure que les outils, les usages et les besoins évoluent.

Quel format choisir selon votre situation

Avant de choisir un format, la vraie première étape consiste à savoir ce qui se passe réellement dans vos équipes. C’est de là que part chacune de mes interventions.

Le bon format dépend d’abord de ce que l’on observe sur le terrain : niveau de maturité des équipes, usages déjà installés, risques identifiés, rôle des managers, types de livrables concernés.

Une conférence IA peut ouvrir le sujet. L’acculturation IA peut créer un socle commun. Un atelier IA permet de travailler sur des cas réels. Une formation IA métier ancre les usages dans les livrables des équipes. Le diagnostic IA sert à prioriser lorsque l’organisation ne sait pas encore par où commencer.

Conclusion

Attendre de finaliser un plan officiel pour encadrer l’IA conduit souvent à intervenir après l’installation des usages. Les équipes ont déjà testé des outils, intégré l’IA dans certains livrables, automatisé des tâches, reformulé des contenus ou préparé des supports avec des méthodes très variables.

Ma recommandation : commencer par observer ce qui existe. Identifier les usages utiles, qualifier les pratiques à sécuriser, puis distinguer ce qui crée de la valeur de ce qui expose l’entreprise.

Ce travail de diagnostic donne à l’accompagnement une base beaucoup plus opérationnelle. En repartant des livrables produits, des outils réellement utilisés, des données mobilisées et des méthodes de vérification, l’entreprise peut construire un cadre applicable, adapté à ses métiers et à ses usages réels.

C’est le point de départ de mes interventions. Avant de parler d’acculturation, de formation ou de déploiement, je cartographie les pratiques existantes pour aider vos équipes à utiliser l’IA avec méthode, et votre organisation à mieux piloter ces usages.